如果機器人有大腦,會是什么樣?

在科幻電影《機械姬》里,全球最大搜索引擎公司“藍(lán)皮書”CEO納森向觀眾展示了自己發(fā)明的機器人大腦,并留下這么一句話:“人們認(rèn)為搜索引擎是人們思考的事物,但其實那是人們思考的方式。”

該影片上映于2015年,被譽為人工智能愛好者必看的電影之一,拿下包括奧斯卡金像獎在內(nèi)等多項國際電影大獎。但在眾多獎項中,單項之冠是“最佳女配角”,艾麗西卡·維坎德,也正是影片中智能機器人“艾娃”的扮演者。

“艾娃”是納森給“她”取的名字,為制造出能獨立思考的人工智能,納森利用自家搜索引擎“藍(lán)皮書”的算法來構(gòu)建艾娃大腦的“思維”,使之學(xué)會人類思考方式。

無獨有偶,想讓機器有人類思維,同樣見之于特斯拉打造的自動駕駛AI上。2019特斯拉自動駕駛?cè)丈希驳卖?middot;卡帕西(Andrej Karpathy,特斯拉AI總負(fù)責(zé)人)曾明確地向大眾傳達特斯拉自動駕駛是在模仿人類駕駛,因為現(xiàn)行的交通系統(tǒng)是基于人類視覺和認(rèn)知系統(tǒng)來設(shè)計的。

由此,特斯拉開發(fā)出“人工神經(jīng)網(wǎng)絡(luò)”,并利用大量有效的行車數(shù)據(jù)來訓(xùn)練它,在這一過程中不斷完善并迭代視覺算法,終于在今年年中拿掉毫米波雷達,而隨著超算Dojo浮出水面,長期被詬病只能算輔助駕駛的特斯拉,離真正的自動駕駛又近一步。

從學(xué)會開車,到比人類更懂開車、開得更好,當(dāng)一名優(yōu)秀的“老司機”,是特斯拉自動駕駛持續(xù)優(yōu)化的底層邏輯。

01“云端司機”的神經(jīng)網(wǎng)絡(luò)

純視覺自動駕駛方案是特斯拉的獨門絕技,但需建立對計算機視覺深度訓(xùn)練之上。

計算機視覺是一種研究機器如何“看”的科學(xué),當(dāng)人類看到一張圖片時,能清晰辨析圖片里的事物,比如說美麗的風(fēng)景照、或者一張小狗的照片,然而計算機看到的卻是像素(pixel),像素是指由圖像的小方格組成的,這些小方塊都有一個明確的位置和相對應(yīng)的色彩數(shù)值,計算機“記住”的就是這堆數(shù)字字符,而不是具體事物。

如果想讓計算機能像人類一樣快速準(zhǔn)確識別出圖片里的事物,機器也有了人工大腦,來模擬人腦處理加工圖像信息過程,分為輸入層、隱藏層、輸出層,里面有許多人工神經(jīng)元,可視作人腦初級視覺皮層中的錐體細(xì)胞和中間神經(jīng)元。

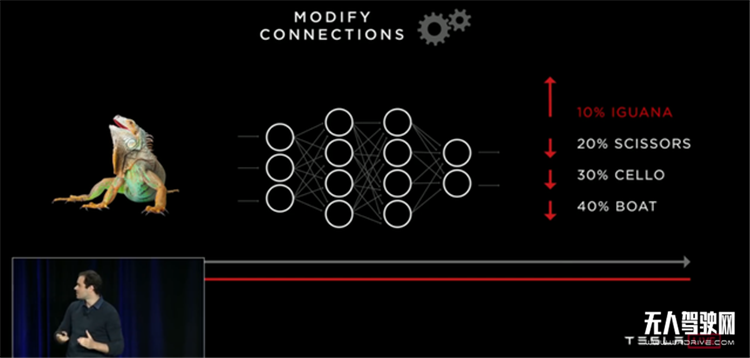

整個訓(xùn)練過程亦可類比小孩看圖識物,通過一次次輸入、對比、糾正,完成機器圖像認(rèn)知。通常在訓(xùn)練初期,人工神經(jīng)網(wǎng)絡(luò)識別結(jié)果的準(zhǔn)確度非常低,輸出結(jié)果和實際值相似度可能只有10%;為了提高準(zhǔn)確度,需要再將兩者誤差從輸出層反向傳播至輸入層,并在反向傳播中,修正神經(jīng)網(wǎng)絡(luò)隱藏層的參數(shù)值,經(jīng)過上百萬次的訓(xùn)練,誤差逐漸將收斂,直至輸入和輸出端匹配度達到99%。

上述過程是理解特斯拉自動駕駛AI的關(guān)鍵,只不過特斯拉開發(fā)的人工神經(jīng)網(wǎng)絡(luò)專注于駕駛領(lǐng)域,做一名專職云端司機。對它來說,最好的學(xué)習(xí)材料就是行車數(shù)據(jù),大量、多樣化、來自真實世界的駕駛訓(xùn)練數(shù)據(jù)集(training dataset)是自動駕駛AI能應(yīng)對各種路況、交通問題的百寶書。

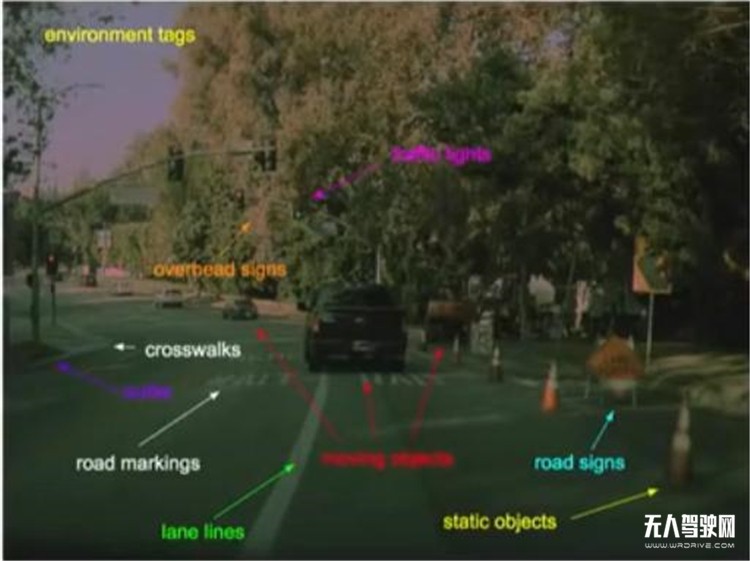

在影子模式的支持下,特斯拉全球百萬車隊每時每刻的行車數(shù)據(jù)都成為這位云端“老司機”提升自身駕駛能力的養(yǎng)分。時至今日,特斯拉Autopilot已經(jīng)能瞬間完成道路上各種動靜目標(biāo)、道路標(biāo)識、交通符號的語義識別,反應(yīng)速度甚至比人腦條件反射更快。

除了應(yīng)對日常駕駛場景外,AI司機還需要處理一些較為少見的長尾情況(Corner cases)。在2020年Matroid機器學(xué)習(xí)大會上,卡帕西以交通指標(biāo)STOP為例,講解Autopilot應(yīng)對這些長尾情況的具體方法。

在日常駕駛過程中,車輛總會經(jīng)過形形色色的STOP指標(biāo),最為正常的情況就是一個立在路旁或者路中、紅底白字的STOP標(biāo)識,但現(xiàn)實生活總會有些預(yù)料之外的情況發(fā)生,駕駛員偶爾會碰上一些奇奇怪怪、需要結(jié)合具體背景來理解意涵的指標(biāo),包括不限于以下:

無效STOP指標(biāo),比如被某人拿在手上,卻無意義;下方附帶文字說明的STOP指標(biāo),比如不限制右行;STOP字母被樹枝、建筑物遮擋的指標(biāo)…這都是些出現(xiàn)頻次不高卻不勝枚舉的情況。

遇到上述情況,人類駕駛員可以輕松識別出絕大部分情況下的“STOP”,并很快作出行動反應(yīng)。但對計算機來說,情況就變得復(fù)雜起來,畢竟它看到的不是具體的"STOP",而是一堆無意義的數(shù)字代碼,如果遇到現(xiàn)有訓(xùn)練數(shù)據(jù)集中沒出現(xiàn)的情況,比如一些上述奇奇怪怪、較為少見的指標(biāo),自動駕駛神經(jīng)網(wǎng)絡(luò)就不能處理。

這部分少見的長尾數(shù)據(jù)通常無窮盡,但又必須在盡可能短的時間內(nèi)學(xué)會應(yīng)對,如果一切都讓人工操作,無疑需要耗費巨大的時間成本和資源。盡管在8月20日AI大會上,卡帕西透露目前特斯拉標(biāo)注團隊規(guī)模已達千人級別,但在海量行車數(shù)據(jù)面前,千人還是顯得杯水車薪,對此特斯拉內(nèi)部開發(fā)了數(shù)據(jù)離線自動標(biāo)注(Data Auto Labeling)以及自動訓(xùn)練框架“數(shù)據(jù)引擎(Data Engine)”。

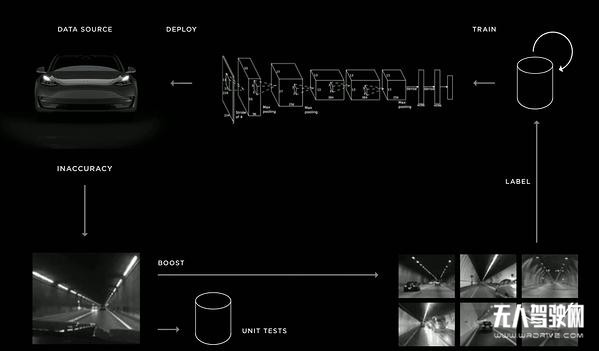

首先,特斯拉神經(jīng)網(wǎng)絡(luò)團隊在對這些長尾情況有所了解后,會先編成一個樣本數(shù)據(jù)集,并為此創(chuàng)造一個局部小型神經(jīng)網(wǎng)絡(luò)來學(xué)習(xí)、訓(xùn)練(與其他神經(jīng)網(wǎng)絡(luò)并行),通過OTA方式部署到全球英語地區(qū)特斯拉車輛上。

再利用車輛影子模式,但凡遇到實際駕駛情況和自動駕駛AI決策不一致的情況,這部分行車數(shù)據(jù)會自動上傳至特斯拉后臺數(shù)據(jù)引擎中,在被自動標(biāo)注后,重新納入已有的數(shù)據(jù)訓(xùn)練集中,繼續(xù)訓(xùn)練原本的神經(jīng)網(wǎng)絡(luò),直到新的數(shù)據(jù)被掌握。

就這樣,在大量訓(xùn)練數(shù)據(jù)的喂養(yǎng)下,神經(jīng)網(wǎng)絡(luò)變得“見多識廣”、更加聰明,可以識別不同條件狀況下的STOP標(biāo)識,精確度逐漸從40%提升至99%,完成單一任務(wù)學(xué)習(xí)。

不過,這僅僅是學(xué)習(xí)一個靜態(tài)的信號,在汽車駕駛過程中會涌現(xiàn)無數(shù)靜態(tài)和動態(tài)的信號,靜態(tài)如路邊大樹、路障、電線桿等,動態(tài)的有行人、車輛等,而這些信號由攝像機捕捉到后交由神經(jīng)網(wǎng)絡(luò)訓(xùn)練、學(xué)習(xí)。目前特斯拉的自動駕駛神經(jīng)網(wǎng)絡(luò)已發(fā)展出九大主干神經(jīng)(HydraNet)和48個神經(jīng)網(wǎng)絡(luò),識別超過1000種目標(biāo)。

然而,僅僅讓自動駕駛AI學(xué)會開車還不夠,還得讓它開得像人類老司機一般駕輕就熟、安全又平穩(wěn)。

02 擺脫拐杖,Autopilot初長成

任何一位經(jīng)驗老道的司機,都能在不同路況下,輕易判斷出前方車輛與我們的距離,從而為保障行車安全而留出一定車距。

但對傳感器而言,要想判斷物體遠(yuǎn)近必須要理解物體的深度,不然在他們眼中,距離我們10米和5米的兩輛完全一樣的車,就會被認(rèn)為是一大一小的關(guān)系。

對此,有些車廠選擇激光雷達路線來探測深度,而特斯拉則選擇了純視覺算法,模仿人類視覺來感知深度,不過特斯拉先是打造了毫米波雷達+視覺傳感融合路線,直到今年5月,才正式官宣,拿掉毫米波雷達,上線純視覺版本Autopilot。

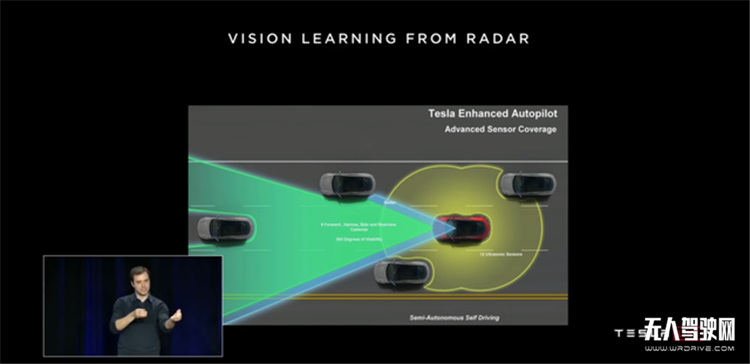

此事一出,社會各界一片嘩然,很多人不能理解特斯拉為何要拿掉單價才300元、又能為行車安全增添保障的高性價比雷達。殊不知,在特斯拉早期多傳感器融合路線中,毫米波雷達的存在就猶如小孩的學(xué)步車,只是幫助神經(jīng)網(wǎng)絡(luò)來學(xué)習(xí)訓(xùn)練深度標(biāo)注(annotate)。

在2019年自動駕駛發(fā)布會上,卡帕西是這樣介紹毫米波雷達的,他說:“要想讓神經(jīng)網(wǎng)絡(luò)學(xué)會預(yù)測深度,最好的方式還是通過深度標(biāo)注的數(shù)據(jù)集進行訓(xùn)練,不過相對于人工標(biāo)注深度,毫米波雷達反饋的深度數(shù)據(jù)精準(zhǔn)度更高”,因此,引入毫米波雷達,實質(zhì)是用以訓(xùn)練和提高神經(jīng)網(wǎng)絡(luò)對深度的預(yù)測。

值得一提的是,在他講解時的背景幻燈片右下角上,清晰地注明了帶有毫米波雷達的自動駕駛算法是“Semi-Automonous Self Driving”,翻譯過來是,半自動駕駛,明顯彼時的特斯拉Autopilot只是個半成品。

直到特斯拉視覺算法在預(yù)測物體的深度、速度、加速度的表現(xiàn),達到可替代毫米波雷達的水平,特斯拉的視覺算法才算真正獨立。

在2021年6月CVPR大會上,卡帕西曾表示毫米波雷達收集數(shù)據(jù)中曾出現(xiàn)“間歇性翻車”、甚至誤判等情況。他舉了三個具體例子,前方車輛急剎車、大橋下前車行駛速度以及對路邊靜止卡車的判斷。

情況一:前方車輛出現(xiàn)急剎,毫米波雷達短時間內(nèi)出現(xiàn)6次跟丟目標(biāo)車的情況,跟丟狀態(tài)下前車的位置、速度和加速度都?xì)w于零。

情況二:在行駛的汽車從大橋下通過時,雷達把一靜一動的物體都當(dāng)作靜止物體;此時視覺傳感卻計算出行駛車輛的速度和位移,導(dǎo)致數(shù)據(jù)融合后的曲線傳遞出“前車在減速并且剎車”的錯誤信息。

情況三:在高速路旁停著一輛白色大卡車,純視覺算法在距目標(biāo)車180m處就發(fā)現(xiàn)白色卡車,并作出預(yù)報,但融合算法直到110m處才作出反饋,足足延遲5秒。

上述案例里,純視覺算法均輸出穩(wěn)定且大幅優(yōu)于雷達+視覺融合算法,精準(zhǔn)地跟蹤到前車行駛狀況并作出深度、速度、加速度等數(shù)據(jù)。

不僅如此,純視覺算法還可以在霧、煙、塵等環(huán)境里保持對前方車輛的測速、測距工作,如此一來拿掉毫米波雷達也不奇怪了。根據(jù)特斯拉AI Day上最新發(fā)布的信息,目前特斯拉每周能夠獲得一萬個人們惡劣環(huán)境下駕車的短視頻,包括大雨、大雪、大霧、黑夜、強光等等情況,神經(jīng)網(wǎng)絡(luò)通過學(xué)習(xí)訓(xùn)練這些已經(jīng)標(biāo)注好的材料,實現(xiàn)在沒有毫米波雷達的情況下,也可以精準(zhǔn)感知前方車輛距離。

可以說,特斯拉宣布拿掉毫米波雷達的底氣,是對自己純視覺算法成熟的自信,并且在無監(jiān)督自學(xué)的加持下,特斯拉純視覺算法迭代和完善明顯提速。

今年7月10日,特斯拉純視覺版本的FSD正式在美開啟內(nèi)測,2000名受邀車主通過OTA方式升級到FSD Beta V9.0版本,他們大多是特斯拉的粉絲兼中小型KOL,Youtube博主Chunk Cook(以下簡稱CC)就是其中之一,他還略懂工程學(xué)和航天學(xué)專業(yè)知識。

系統(tǒng)更新一結(jié)束,CC開啟新版FSD道路測試,并把測試視頻上傳至油管。視頻中他來到一個車輛較多、車速較快的T路口進行轉(zhuǎn)彎測試,結(jié)果顯示,7次中只有1次,F(xiàn)SD順利完成自動駕駛,其余都需要人工接管方向盤來完成駕駛。

但很快,隨著7月底FSD推送新版本V9.1,CC發(fā)現(xiàn)升級后的FSD表現(xiàn)出乎他的意料。他又在相同道路進行了七次自動駕駛測試,結(jié)果顯示,7次中4次都較為順利完成自動駕駛,但在轉(zhuǎn)彎速度上有些“磨蹭”,沒有展現(xiàn)老司機應(yīng)有的果斷,但在綜合得分上,新版本Autopilot優(yōu)于舊版本。

8月16日,特斯拉FSD又升級至新版本V9.2,CC同樣搶先測試并上傳視頻,還是一個路段,不過測試時間改為夜間,他公開表示,此次最明顯的改進是Autopilot的加速表現(xiàn),在轉(zhuǎn)彎時能像人類駕駛員一樣果斷加速。

前后一個月的時間,純視覺Autopilot在同一條道路的表現(xiàn)進步迅速,身后正是人工神經(jīng)網(wǎng)絡(luò)強悍自學(xué)能力的體現(xiàn)。馬斯克表示,F(xiàn)SD beta V9.3、9.4都已在籌備中,會根據(jù)車主使用情況不斷進行細(xì)節(jié)優(yōu)化,改善用戶體驗,并預(yù)備在V10版本做出現(xiàn)重大的變化。

03 Dojo上馬,模擬極限

需要注意的是,大家驚艷特斯拉純視覺Autopilot各種老司機操作時,也不能忘記這些路測大部分發(fā)生在北美地區(qū),而在非英語地區(qū),比如人口稠密的亞洲地區(qū),其城市道路交通復(fù)雜度與地廣人稀的北美迥異,而如何讓神經(jīng)網(wǎng)絡(luò)學(xué)會應(yīng)對各種路況交通,更值得思考。

收集實地數(shù)據(jù)是方法之一,但前提是你有大量車隊在該地區(qū)駕駛,另一種解決方法則是對自動駕駛進行仿真測試。仿真,簡單講就是利用現(xiàn)實數(shù)據(jù),將真實世界的實時動態(tài)景象,在計算機系統(tǒng)實現(xiàn)重新構(gòu)建和重現(xiàn)。

除了能模擬不同城市的交通路況,而且仿真測試還能模擬一些極限場景,比如各種突發(fā)交通事件或者極為罕見的交通路況。在AI DAY上,特斯拉工程師舉了具體例子,包括有行人在高速路上奔跑、行人數(shù)量龐大、或者非常狹窄的駕駛道路。

這些案例往往非常極端,在日常駕駛場景中出現(xiàn)的概率也微乎其微,但正因為此,通過仿真來訓(xùn)練神經(jīng)網(wǎng)絡(luò)才有真正價值,而只有通過訓(xùn)練,神經(jīng)網(wǎng)絡(luò)才能學(xué)會正確應(yīng)對。

為了能真正起到訓(xùn)練作用,這些仿真測試必須充分還原現(xiàn)實場景,包括道路上各種行人、車輛、綠化林、路障、信號燈等等,幾乎包含你在路上見到的所有交通要素。目前特斯拉已創(chuàng)建了3.71億張車內(nèi)網(wǎng)絡(luò)訓(xùn)練的圖像,以及4.8億個標(biāo)簽,并且數(shù)據(jù)規(guī)模還在快速擴張中。

要知道,仿真測試可達到的逼真程度,與計算機可提供的數(shù)據(jù)處理能力成正比。特斯拉AI的仿真越強,對硬件算力、讀寫速度的要求越高。

馬斯克曾在2020WAIC大會上表示,當(dāng)下計算機視覺已經(jīng)超越人類專家水平,但要保證計算機視覺實現(xiàn)的關(guān)鍵是算力的大小,為此特斯拉則準(zhǔn)備好了頂級超算Dojo,保證一切運算都能高效、準(zhǔn)確完成。

在AI day上,超算Dojo揭開了廬山真面目,內(nèi)置了3000顆Dojo 1芯片,并組裝成峰值算力達到1.1EFLOPS的ExaPOD,超越目前世界上最快的超算日本富岳,就成了全球第一。在發(fā)布會后,馬斯克在推特上回復(fù)網(wǎng)友提問時表示,ExaPOD的運算能力足以模擬人腦。

現(xiàn)階段,Dojo這臺性能猛獸專注于訓(xùn)練特斯拉自動駕駛神經(jīng)網(wǎng)絡(luò),有了它,神經(jīng)網(wǎng)絡(luò)的學(xué)習(xí)潛力一下子變得深不可測,而至此,特斯拉也集齊自動駕駛?cè)兀瑪?shù)據(jù)、算法、算力,為推進L5級別自動駕駛做好軟硬件準(zhǔn)備。

不過要想快進至自動駕駛終局,特斯拉還有很長的路要走,包括來自法律和道德層面的考驗。